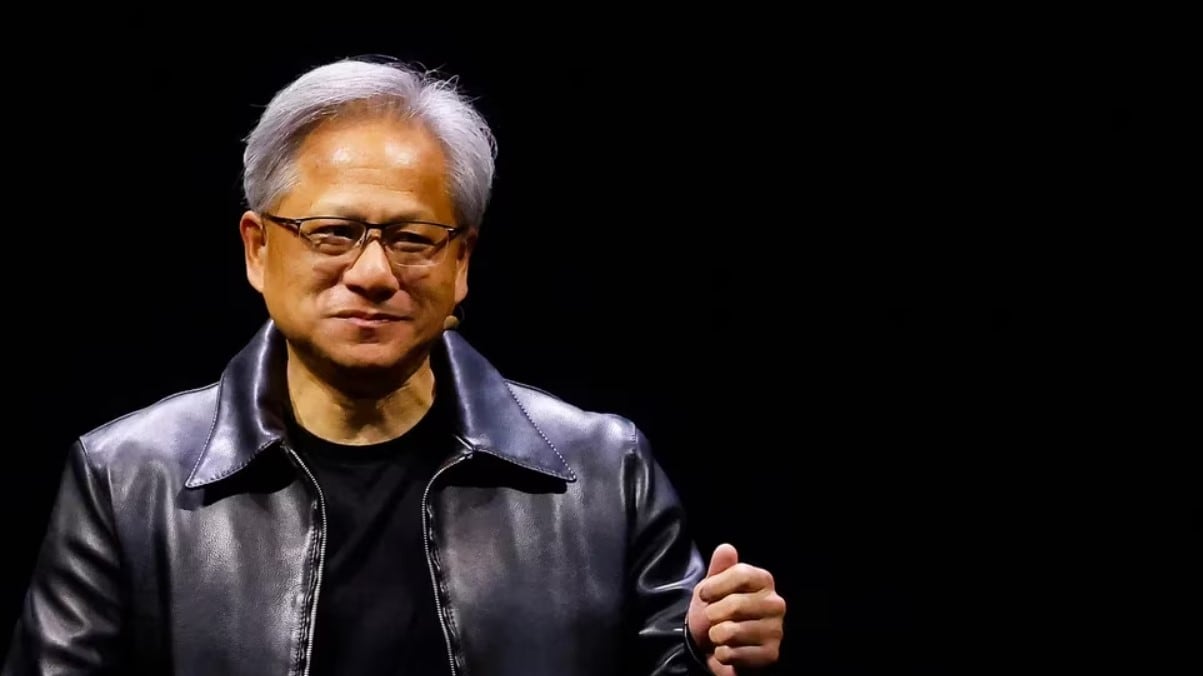

En Wall Street algunos ven exuberancia; en Santa Clara, Jensen Huang ve inevitabilidad. El jefe de Nvidia sostiene que la computación acelerada que su compañía vende a ritmo de sold out no es una moda, sino la plataforma que impregnará todo: del código a las factorías robotizadas.

Te puede interesar: [Efectos de la IA: Microsoft estaría prensando en replantear todo su modelo de negocio, según su CEO]

Su optimismo encendió al mercado con subidas superiores al 5%, aunque el coro de dudas—clientes hiperconcentrados, acuerdos circulares y centros de datos hambrientos de energía—no baja el volumen.

La tesis de Huang: tres transiciones y una sola arquitectura

Para Huang, llamar “burbuja” a la IA es perder de vista el mapa. Su guion tiene tres actos:

- migración del software clásico (simulación, ciencia de datos) desde CPUs a GPU;

- surgimiento de nuevas categorías (asistentes de programación, agentes);

- salto de lo virtual a lo físico: coches, fábricas, robots “a legiones”.

La clave, repite, es que una misma arquitectura de Nvidia permite las tres y, por tanto, alimenta una demanda sostenida de infraestructura por años. No es hype, es pipeline.

El dato que incomoda: demasiados huevos en pocas canastas

Los números acompañan el relato… y también las cejas levantadas. Nvidia reportó ingresos trimestrales de 57.000 millones de dólares y reconoció que el 61% provino de cuatro clientes sin identificar (pistas previas apuntan a hyperscalers como Microsoft, Meta u Oracle).

Además, duplicó el gasto en alquiler de sus propios chips vía nube hasta 26.000 millones, con contratos que van hasta 2031. Y anunció grandes inversiones en OpenAI y Anthropic.

Para los escépticos, esa red de relaciones puede parecer circular: los mismos actores que compran capacidad reciben inversiones y compromisos a largo plazo. Si los retornos financieros de la IA tardan, el aterrizaje podría ser abrupto.

Tierra, energía y hormigón: el otro cuello de botella

Huang no elude la logística: para que ese futuro ocurra hacen falta muchos centros de datos, con terreno, potencia y financiación. Según él, Nvidia ya amarra alianzas en esos frentes para que los cuellos de botella no apaguen la fiesta. “Difícil, pero manejable”, promete.

Aun los optimistas piden ver capex energético y calendarios realistas antes de brindar con otra ronda.

La competencia no mira desde la banca

Mientras los H100 y sucesores vuelan, Alphabet y Amazon aceleran sus chips propios y amplían oferta a los mismos clientes de Nvidia.

Con el stock agotado gran parte de este año (y probablemente el próximo), algunos analistas se preguntan de dónde saldrán nuevas sorpresas positivas. La lista de riesgos—competencia, costes, regulación, demanda que se normaliza—es larga, advierten.

¿Burbuja o marea larga?

Para Nvidia, esto no es 1999: es un cambio de plataforma que reconfigura cómo se construye y corre el software… y cómo se automatiza el mundo físico. Para los cautos, el guion depende de pocos clientes gigantes, márgenes por demostrar y un apetito energético que no se resuelve con un driver.

Lo único incontestable hoy es que la IA ya mueve cifras colosales y que Nvidia está en el centro del escenario.

Te puede interesar: [¿De qué se trata el grupo de trabajo sobre IA que pidió Putin para Rusia?]

Si es burbuja o punto de inflexión no se decidirá en un trimestre, sino en si los casos de uso escalan fuera del PowerPoint y pagan la cuenta. De momento, Huang pide paciencia; los inversores, pruebas.