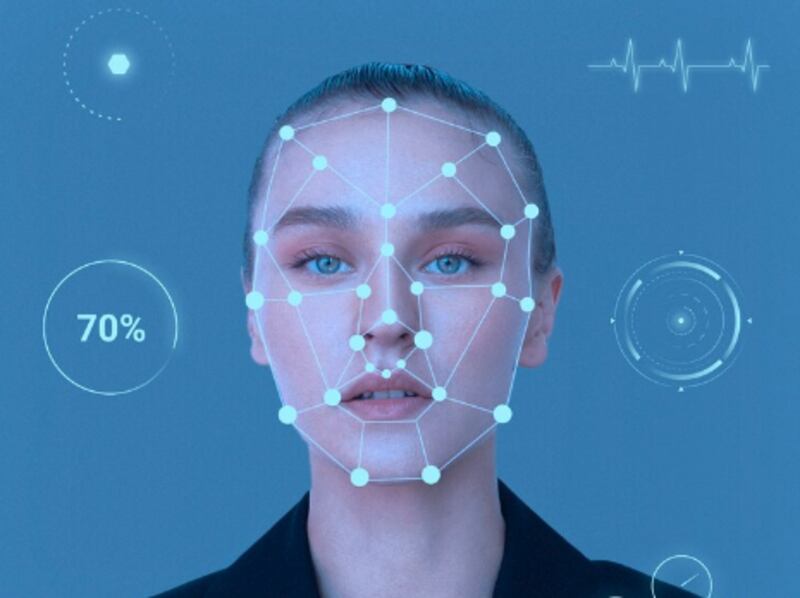

En internet, una foto siempre llega con una promesa implícita: “esto pasó”. El problema es que, desde que la inteligencia artificial aprendió a fabricar imágenes convincentes, esa promesa viene con letra chica. Aun así, no todo está perdido.

Te puede interesar: [Así puedes mejorar una de las fotos más difíciles de tomar: las que están en movimiento]

Investigadores encontraron que algunas personas tienen una ventaja inesperada para descubrir lo falso: no porque sepan programar, ni porque trabajen en tecnología, sino porque su percepción visual está mejor afinada para detectar lo raro.

El nuevo reto: cuando lo “realista” ya no basta

La proliferación de imágenes generadas por IA abrió un desafío enorme para la veracidad digital. En redes sociales y medios, una imagen puede viajar rápido, emocionar, indignar o convencer… incluso si nunca existió.

El discurso dominante suele sonar fatalista: “ya es imposible distinguir lo real de lo artificial”.

Sin embargo, un estudio reciente de Vanderbilt University plantea un matiz importante: no todas las personas son igual de vulnerables al engaño visual. Hay diferencias individuales notorias, y entenderlas puede cambiar la conversación sobre desinformación.

El “AI Face Test”: una prueba para separar intuición de conocimiento

Para medir esas diferencias, el equipo liderado por Isabel Gauthier, Jason Chow y Rankin McGugin diseñó una prueba llamada AI Face Test. La idea fue directa: presentar rostros reales y sintéticos, y observar qué tan bien cada participante podía clasificarlos.

La investigación buscaba algo muy concreto: comprobar si variables como la inteligencia general, la experiencia profesional en tecnología o incluso una formación específica sobre IA mejoraban el rendimiento.

Y aquí viene el giro: no lo hicieron. La precisión al detectar rostros generados por IA no aumentó de manera relevante por “saber más de tecnología”.

El estudio, publicado en Journal of Experimental Psychology, apunta así a una conclusión incómoda para los mitos modernos: entender cómo funciona la IA no equivale a detectarla cuando se disfraza de fotografía.

La habilidad que sí marca la diferencia: reconocer objetos (muy) parecidos

Según Vanderbilt, el predictor más fuerte fue otro: la capacidad para distinguir y categorizar objetos visualmente similares. Es una destreza perceptiva que permite notar patrones anómalos, pequeñas inconsistencias o “ruido” que no encaja con lo natural.

Esa habilidad aparece con frecuencia en profesiones donde mirar detalles mínimos es parte del trabajo, como radiología o patología.

Quienes están acostumbrados a detectar un nódulo pequeño en una imagen médica o a clasificar células con precisión tienden a sobresalir: su cerebro está entrenado (o predispuesto) a encontrar diferencias sutiles donde otros ven “más o menos lo mismo”.

Isabel Gauthier lo resumió con una idea clave: es una capacidad visual con aplicaciones generales, útil para enfrentar desafíos perceptivos nuevos, incluidos los creados por la inteligencia artificial.

¿Se puede entrenar o es un “superpoder” fijo?

La investigación también miró un punto sensible: si esta habilidad mejora con práctica. Aquí el resultado fue menos romántico. A diferencia de aprender un idioma o perfeccionar un deporte, el reconocimiento de objetos parece ser un rasgo bastante estable.

Incluso cuando se evalúa repetidas veces a las mismas personas, quienes destacan suelen seguir destacando, y quienes no, no necesariamente “suben” mucho con repetición.

Eso no significa que no se pueda mejorar nada. Sí se pueden aprender señales específicas (por ejemplo, sombras extrañas o anomalías típicas), pero el estudio sugiere que quienes detectan mejor lo falso lo hacen por una sensibilidad más general a patrones visuales raros, no por memorizar trucos.

Una noticia útil en tiempos de desinformación visual

El aporte más interesante es social: si no todo el mundo detecta igual, entonces la estrategia para enfrentar imágenes falsas puede ser más inteligente que el simple “nadie puede”.

Identificar a personas con alta capacidad perceptiva podría ayudar en equipos de verificación o en procesos donde se requiere una primera alerta humana.

Te puede interesar: [¿Sabés cuánta vida útil tiene un Smart TV? Así puedes calcularlo]

En resumen, frente a la idea de que la IA engañará a cualquiera siempre, el estudio propone una visión más realista (y un poco más optimista): la vulnerabilidad no es universal.

Hay quienes caen fácil, quienes sospechan a tiempo y una gran mayoría en un punto medio. La diferencia, sorprendentemente, no está en saber de IA… sino en saber mirar.